Canales de transmisión de datos y sus características. Canales de conexión

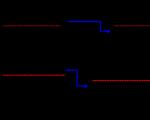

La transferencia de información se produce desde la fuente hasta el destinatario (receptor) de la información. fuente la informacion puede ser cualquier cosa: cualquier objeto o fenomeno de naturaleza viva o inanimada. El proceso de transferencia de información tiene lugar en algún entorno material que separa la fuente y el receptor de la información, que se denomina canal transferencia de información. La información se transmite a través de un canal en forma de una determinada secuencia de señales, símbolos, signos, que se denominan mensaje. Recipiente la información es un objeto que recibe un mensaje, como resultado del cual ocurren ciertos cambios en su estado. Todo lo anterior se muestra esquemáticamente en la figura.

Transferencia de información

Una persona recibe información de todo lo que le rodea, a través de los sentidos: oído, vista, olfato, tacto, gusto. Una persona recibe la mayor cantidad de información a través del oído y la vista. Los mensajes de sonido son percibidos por el oído: señales acústicas en un medio continuo (la mayoría de las veces en el aire). La visión percibe señales de luz que llevan la imagen de los objetos.

No todos los mensajes son informativos para una persona. Por ejemplo, un mensaje en un idioma incomprensible, aunque transmitido a una persona, no contiene información para ella y no puede provocar cambios adecuados en su estado.

Un canal de información puede ser de naturaleza natural (aire atmosférico a través del cual se transmiten ondas sonoras, luz solar reflejada por los objetos observados) o creado artificialmente. En este último caso, estamos hablando de medios técnicos de comunicación.

Sistemas de transmisión de información técnica

El primer medio técnico de transmisión de información a distancia fue el telégrafo, inventado en 1837 por el estadounidense Samuel Morse. En 1876, el estadounidense A. Bell inventa el teléfono. Basado en el descubrimiento de las ondas electromagnéticas por el físico alemán Heinrich Hertz (1886), A.S. Popov en Rusia en 1895 y casi simultáneamente con él en 1896 G. Marconi en Italia, se inventó la radio. La televisión e Internet aparecieron en el siglo XX.

Todos los métodos técnicos de comunicación de información enumerados se basan en la transmisión de una señal física (eléctrica o electromagnética) a distancia y están sujetos a ciertas leyes generales. El estudio de estas leyes es teoría de la comunicación que surgió en la década de 1920. Aparato matemático de la teoría de la comunicación - teoría matemática de la comunicación, desarrollado por el científico estadounidense Claude Shannon.

Claude Elwood Shannon (1916–2001), EE. UU.

Claude Shannon propuso un modelo para el proceso de transmisión de información a través de canales técnicos de comunicación, representado por un diagrama.

Sistema de transmisión de información técnica

Codificar aquí significa cualquier transformación de información proveniente de una fuente en una forma adecuada para su transmisión a través de un canal de comunicación. Descodificación - transformación inversa de la secuencia de la señal.

El funcionamiento de tal esquema puede explicarse por el proceso familiar de hablar por teléfono. La fuente de información es la persona que habla. Un codificador es un micrófono de mano que convierte las ondas de sonido (habla) en señales eléctricas. El canal de comunicación es la red telefónica (cables, conmutadores de nodos telefónicos a través de los cuales pasa la señal). El dispositivo decodificador es un auricular (auricular) de la persona que escucha, el receptor de la información. Aquí la señal eléctrica entrante se convierte en sonido.

Los sistemas informáticos modernos para transmitir información (redes informáticas) funcionan según el mismo principio. Existe un proceso de codificación que convierte un código informático binario en una señal física del tipo que se transmite a través de un canal de comunicación. La decodificación es la transformación inversa de la señal transmitida en código de computadora. Por ejemplo, cuando se utilizan líneas telefónicas en redes informáticas, las funciones de codificación y decodificación las realiza un dispositivo llamado módem.

Capacidad del canal y tasa de transferencia de información

Los desarrolladores de sistemas de transmisión de información técnica deben resolver dos tareas interrelacionadas: cómo garantizar la máxima velocidad de transferencia de información y cómo reducir la pérdida de información durante la transmisión. Claude Shannon fue el primer científico que asumió la solución de estos problemas y creó una nueva ciencia para esa época: Teoría de la información.

K.Shannon determinó el método para medir la cantidad de información transmitida a través de los canales de comunicación. Introdujeron el concepto Canal de Banda ancha,como la tasa de transferencia de información máxima posible. Esta velocidad se mide en bits por segundo (así como en kilobits por segundo, megabits por segundo).

El rendimiento de un canal de comunicación depende de su implementación técnica. Por ejemplo, las redes informáticas utilizan los siguientes medios de comunicación:

líneas telefónicas,

Conexión de cables eléctricos,

cableado de fibra óptica,

Comunicación por radio.

Rendimiento de las líneas telefónicas: decenas, cientos de Kbps; el rendimiento de las líneas de fibra óptica y las líneas de comunicación por radio se mide en decenas y cientos de Mbps.

Ruido, protección contra el ruido

El término "ruido" se refiere a varios tipos de interferencia que distorsionan la señal transmitida y conducen a la pérdida de información. Dicha interferencia ocurre principalmente debido a razones técnicas: mala calidad de las líneas de comunicación, inseguridad entre sí de varios flujos de información transmitidos por los mismos canales. A veces, mientras hablamos por teléfono, escuchamos ruidos, crujidos, que dificultan la comprensión del interlocutor, o la conversación de personas completamente diferentes se superpone a nuestra conversación.

La presencia de ruido conduce a la pérdida de la información transmitida. En tales casos es necesaria la protección contra el ruido.

En primer lugar, se utilizan métodos técnicos para proteger los canales de comunicación de los efectos del ruido. Por ejemplo, usar cable blindado en lugar de cable desnudo; el uso de varios tipos de filtros que separan la señal útil del ruido, etc.

Claude Shannon desarrolló teoría de la codificación, que proporciona métodos para tratar el ruido. Una de las ideas importantes de esta teoría es que el código transmitido por la línea de comunicación debe ser redundante. Debido a esto, se puede compensar la pérdida de alguna parte de la información durante la transmisión. Por ejemplo, si es difícil escucharlo cuando habla por teléfono, al repetir cada palabra dos veces, tiene más posibilidades de que el interlocutor lo entienda correctamente.

Sin embargo, no puede hacer que la redundancia sea demasiado grande. Esto conducirá a retrasos y mayores costos de comunicación. La teoría de la codificación le permite obtener un código que será óptimo. En este caso, la redundancia de la información transmitida será la mínima posible y la fiabilidad de la información recibida será la máxima.

En los sistemas de comunicación digital modernos, la siguiente técnica se usa a menudo para combatir la pérdida de información durante la transmisión. Todo el mensaje se divide en porciones: paquetes. Para cada paquete se calcula suma de control(suma de dígitos binarios) que se transmite con este paquete. En el lugar de recepción, se vuelve a calcular la suma de control del paquete recibido y, si no coincide con la suma original, se repite la transmisión de este paquete. Esto continuará hasta que las sumas de verificación inicial y final coincidan.

Considerando la transferencia de información en cursos propedéuticos y de informática básica, en primer lugar, este tema debe ser discutido desde la posición de una persona como receptora de información. La capacidad de recibir información del mundo circundante es la condición más importante para la existencia humana. Los órganos de los sentidos humanos son los canales de información del cuerpo humano, llevando a cabo la conexión de una persona con el entorno externo. Sobre esta base, la información se divide en visual, auditiva, olfativa, táctil y gustativa. La razón por la que el gusto, el olfato y el tacto transmiten información a una persona es la siguiente: recordamos los olores de los objetos familiares, el sabor de la comida familiar, reconocemos los objetos familiares por el tacto. Y el contenido de nuestra memoria es información almacenada.

Se debe decir a los estudiantes que en el mundo animal el papel informativo de los sentidos es diferente al humano. El sentido del olfato desempeña una importante función informativa para los animales. Los organismos encargados de hacer cumplir la ley utilizan el elevado sentido del olfato de los perros de servicio para buscar delincuentes, detectar drogas, etc. La percepción visual y auditiva de los animales difiere de la de los humanos. Por ejemplo, se sabe que los murciélagos escuchan ultrasonido y que los gatos ven en la oscuridad (desde una perspectiva humana).

En el marco de este tema, los estudiantes deben poder dar ejemplos específicos del proceso de transmisión de información, determinar para estos ejemplos la fuente, el receptor de información y los canales utilizados para transmitir información.

Al estudiar informática en la escuela secundaria, los estudiantes deben conocer las disposiciones básicas de la teoría técnica de la comunicación: los conceptos de codificación, decodificación, tasa de transferencia de información, capacidad del canal, ruido, protección contra el ruido. Estos problemas pueden considerarse en el marco del tema "Medios técnicos de redes informáticas".

En la fig. 1 adoptó las siguientes designaciones: X, Y, Z, W- señales, mensajes ; F- obstáculo; LS- línea de comunicación; IA, IP– fuente y receptor de información; PAG– convertidores (codificación, modulación, decodificación, demodulación).

Existen varios tipos de canales que se pueden clasificar según varios criterios:

1.Por tipo de líneas de comunicación: cableado; cable; fibra óptica;

líneas eléctricas; canales de radio, etc

2. Por la naturaleza de las señales: continuo; discreto; discreto-continuo (las señales en la entrada del sistema son discretas, y en la salida son continuas, y viceversa).

3. Para inmunidad al ruido: canales sin interferencias; con interferencia

Los canales de comunicación se caracterizan por:

1. Capacidad del canal definido como el producto del tiempo de uso del canal t a, el ancho del espectro de frecuencias transmitidas por el canal F a y rango dinámico D a. , que caracteriza la capacidad del canal para transmitir diferentes niveles de señales

V a = T a F a D a. (1)

La condición para hacer coincidir la señal con el canal:

v.c. £ vk ; T C £ T k ; F C £ F k ; v.c. £ vk ; Corriente continua £ D k.

2.Tasa de transferencia de información - la cantidad media de información transmitida por unidad de tiempo.

3.

4. Redundancia - garantiza la fiabilidad de la información transmitida ( R= 0¸1).

Una de las tareas de la teoría de la información es determinar la dependencia de la tasa de transferencia de información y la capacidad del canal de comunicación de los parámetros del canal y las características de las señales y la interferencia.

Un canal de comunicación puede compararse en sentido figurado con las carreteras. Carreteras estrechas: poca capacidad, pero económicas. Carreteras anchas: buena capacidad de tráfico, pero costosas. El rendimiento está determinado por el cuello de botella.

La tasa de transferencia de datos depende en gran medida del medio de transmisión en los canales de comunicación, que son varios tipos de líneas de comunicación.

Alámbrico:

1. cableado– par trenzado (que suprime parcialmente la radiación electromagnética de otras fuentes). Velocidad de transmisión de hasta 1 Mbps. Utilizado en redes telefónicas y para transmisión de datos.

2. Cable coaxial. Tasa de transferencia 10-100 Mbps - utilizado en redes locales, televisión por cable, etc.

3. Fibra óptica. Tasa de transferencia 1 Gbps.

En los entornos 1-3, la atenuación en dB es lineal con la distancia, es decir, la potencia cae exponencialmente. Por lo tanto, después de cierta distancia, es necesario instalar regeneradores (amplificadores).

Radioenlaces:

1.Canal de radio. Tasa de transferencia 100–400 Kbps. Utiliza frecuencias de radio de hasta 1000 MHz. Hasta 30 MHz debido a la reflexión de la ionosfera, es posible la propagación de ondas electromagnéticas más allá de la línea de visión. Pero este rango es muy ruidoso (por ejemplo, por radioaficionados). De 30 a 1000 MHz: la ionosfera es transparente y se requiere línea de visión. Se instalan antenas en altura (a veces se instalan regeneradores). Utilizado en radio y televisión.

2.líneas de microondas. Velocidades de transferencia de hasta 1 Gbps. Utilice frecuencias de radio por encima de 1000 MHz. Esto requiere línea de visión y antenas parabólicas altamente direccionales. La distancia entre los regeneradores es de 10 a 200 km. Se utiliza para telefonía, televisión y transmisión de datos.

3. Conexión satelital. Se utilizan frecuencias de microondas y el satélite sirve como regenerador (y para muchas estaciones). Las características son las mismas que para las líneas de microondas.

2. Ancho de banda de un canal de comunicación discreto

Un canal discreto es un conjunto de medios diseñados para transmitir señales discretas.

Ancho de banda del canal de comunicación - la tasa de transferencia de información más alta teóricamente alcanzable, siempre que el error no exceda un valor dado. Tasa de transferencia de información - la cantidad media de información transmitida por unidad de tiempo. Definamos expresiones para calcular la tasa de transferencia de información y el rendimiento de un canal de comunicación discreto.

Durante la transmisión de cada símbolo, en promedio, la cantidad de información pasa a través del canal de comunicación, que está determinada por la fórmula

Yo (Y, X) = Yo (X, Y) = H(X) - H (X/Y) = H(Y) - H (Y/X) , (2)

Dónde: Yo (Y, X) - información mutua, es decir, la cantidad de información contenida en Y relativamente X ;H(X) es la entropía de la fuente del mensaje; H (X/Y)– entropía condicional, que determina la pérdida de información por símbolo asociada a la presencia de ruido y distorsión.

Al enviar un mensaje XT duración T, que consiste en norte símbolos elementales, la cantidad promedio de información transmitida, teniendo en cuenta la simetría de la cantidad mutua de información, es:

yo(Y T , X T) = H(X T) – H(X T /Y T) = H(Y T) – H(Y T /X T) = norte . (4)

La tasa de transferencia de información depende de las propiedades estadísticas de la fuente, el método de codificación y las propiedades del canal.

Ancho de banda de un canal de comunicación discreto

. (5)

. (5)

El valor máximo posible, es decir, el máximo del funcional se busca en todo el conjunto de funciones de distribución de probabilidad p (X) .

El ancho de banda depende de las características técnicas del canal (velocidad del equipo, tipo de modulación, nivel de interferencia y distorsión, etc.). Las unidades de capacidad del canal son: , , , .

2.1 Canal de comunicación discreto sin interferencia

Si no hay interferencia en el canal de comunicación, entonces las señales de entrada y salida del canal están conectadas por una dependencia funcional inequívoca.

En este caso, la entropía condicional es igual a cero, y las entropías incondicionales de la fuente y el receptor son iguales, es decir la cantidad promedio de información en el símbolo recibido en relación con el transmitido es

Yo (X, Y) = H(X) = H(Y); H(X/Y) = 0.

Si XT- número de caracteres por tiempo T, entonces la tasa de transferencia de información para un canal de comunicación discreto sin interferencia es igual a

(6)Dónde V = 1/ es la tasa de transmisión promedio de un símbolo.

Ancho de banda para un canal de comunicación discreto sin interferencias

Porque la máxima entropía corresponde a símbolos equiprobables, entonces el ancho de banda para distribución uniforme e independencia estadística de los símbolos transmitidos es igual a:

Primer teorema de Shannon para un canal: Si el flujo de información generado por la fuente está lo suficientemente cerca del ancho de banda del canal de comunicación, es decir,

![]() , donde es un valor arbitrariamente pequeño,

, donde es un valor arbitrariamente pequeño,

entonces siempre es posible encontrar un método de codificación que asegure la transmisión de todos los mensajes fuente, y la tasa de transferencia de información será muy cercana a la capacidad del canal.

El teorema no responde a la pregunta de cómo codificar.

Ejemplo 1 La fuente genera 3 mensajes con probabilidades:

pag 1 = 0,1; pag 2 = 0.2 y pag 3 = 0,7.

Los mensajes son independientes y se transmiten en un código binario uniforme ( metro = 2 ) con una duración de símbolo de 1 ms. Determine la tasa de transferencia de información a través de un canal de comunicación sin interferencia.

Solución: La entropía de la fuente es

[bps].

Para transmitir 3 mensajes con un código uniforme, se requieren dos bits, mientras que la duración de la combinación de códigos es de 2t.

Tasa de señal promedio

V =1/2 t = 500 .

Tasa de transferencia de información

C = vH = 500 × 1,16 = 580 [bps].

2.2 Canal de comunicación discreto con ruido

Consideraremos canales de comunicación discretos sin memoria.

Canal sin memoria Un canal se denomina canal en el que cada símbolo de señal transmitido se ve afectado por la interferencia, independientemente de las señales que se hayan transmitido previamente. Es decir, la interferencia no crea enlaces correlativos adicionales entre símbolos. El nombre "sin memoria" significa que durante la siguiente transmisión, el canal parece no recordar los resultados de las transmisiones anteriores.

Tema 1.4: Fundamentos de las redes locales

Tema 1.5: Tecnologías LAN básicas

Tema 1.6: Componentes básicos de software y hardware de una LAN

Redes locales

1.2. Entorno y métodos de transmisión de datos en redes informáticas.

1.2.2. Líneas de comunicación y canales de datos

Para construir redes informáticas, se utilizan líneas de comunicación que utilizan un medio físico diferente. Como medio físico en las comunicaciones se utilizan metales (principalmente cobre), vidrio ultratransparente (cuarzo) o plástico y éter. El medio de transmisión física puede ser cable de par trenzado, cable coaxial, cable de fibra óptica y el área circundante.

Las líneas de comunicación o líneas de transmisión de datos son equipos intermedios y medios físicos a través de los cuales se transmiten señales de información (datos).

Se pueden formar varios canales de comunicación (canales virtuales o lógicos) en una línea de comunicación, por ejemplo, por frecuencia o división de tiempo de los canales. Un canal de comunicación es un medio de transmisión de datos unidireccional. Si la línea de comunicación es utilizada exclusivamente por el canal de comunicación, entonces en este caso la línea de comunicación se denomina canal de comunicación.

Un canal de transmisión de datos es un medio de intercambio de datos bidireccional, que incluye líneas de comunicación y equipos de transmisión (recepción) de datos. Los canales de transmisión de datos conectan fuentes de información y receptores de información.

Dependiendo del medio físico de transmisión de datos, las líneas de comunicación se pueden dividir en:

- líneas de comunicación por cable sin trenzas aislantes y de protección;

- cable, cuando se utilicen líneas de comunicación como cables de par trenzado, cables coaxiales o cables de fibra óptica para la transmisión de señales;

- inalámbricos (canales de radio de comunicaciones terrestres y satelitales), que utilizan ondas electromagnéticas que se propagan por el aire para transmitir señales.

Líneas de comunicación por cable

Las líneas de comunicación por cable (aéreas) se utilizan para transmitir señales de teléfono y telégrafo, así como para transmitir datos informáticos. Estas líneas de comunicación se utilizan como líneas de comunicación troncales.

Las líneas de comunicación por cable se pueden utilizar para organizar canales de transmisión de datos analógicos y digitales. La velocidad de transmisión sobre las líneas alámbricas del Primitive Old Telephone System (POST) es muy lenta. Además, las desventajas de estas líneas incluyen la inmunidad al ruido y la posibilidad de una simple conexión no autorizada a la red.

Líneas de comunicación por cable

Las líneas de comunicación por cable tienen una estructura bastante compleja. El cable consta de conductores encerrados en varias capas de aislamiento. Hay tres tipos de cables que se utilizan en las redes informáticas.

par trenzado(par trenzado) - un cable de comunicación, que es un par trenzado de hilos de cobre (o varios pares de hilos) encerrados en una cubierta blindada. Los pares de cables están trenzados para reducir la interferencia. El par trenzado es bastante resistente al ruido. Hay dos tipos de este cable: par trenzado sin blindaje UTP y par trenzado blindado STP.

La característica de este cable es la facilidad de instalación. Este cable es el tipo de comunicación más económico y común, el cual es ampliamente utilizado en las redes locales más comunes con arquitectura Ethernet, construidas sobre una topología en estrella. El cable se conecta a los dispositivos de red mediante un conector RJ45.

El cable se utiliza para la transmisión de datos a 10 Mbps y 100 Mbps. El par trenzado se usa típicamente para comunicaciones a una distancia de no más de unos pocos cientos de metros. Las desventajas de un cable de par trenzado incluyen la posibilidad de una simple conexión no autorizada a la red.

Cable coaxial(cable coaxial) es un cable con un alambre central de cobre, que está rodeado por una capa de material aislante para separar el conductor central del blindaje conductor externo (trenza de cobre o capa de papel de aluminio). La pantalla conductora exterior del cable está cubierta con aislamiento.

Hay dos tipos de cable coaxial: cable coaxial delgado con un diámetro de 5 mm y cable coaxial grueso con un diámetro de 10 mm. Un cable coaxial grueso tiene menos atenuación que uno delgado. El costo del cable coaxial es más alto que el costo del par trenzado y la instalación de la red es más difícil que la del par trenzado.

El cable coaxial se utiliza, por ejemplo, en redes locales con arquitectura Ethernet, construidas sobre una topología de "bus común".

El cable coaxial es más inmune a las interferencias que el par trenzado y reduce su propia radiación. Ancho de banda - 50-100 Mbps. La longitud permitida de la línea de comunicación es de varios kilómetros. La conexión no autorizada al cable coaxial es más difícil que al par trenzado.

Canales de comunicación por cable de fibra óptica. Un cable de fibra óptica es una fibra óptica a base de silicona o plástico, encerrada en un material con un índice de refracción de la luz bajo, que está cerrado por una funda exterior.

La fibra óptica solo transmite señales en una dirección, por lo que el cable consta de dos fibras. En el extremo transmisor del cable de fibra óptica se requiere la conversión de la señal eléctrica en luz, y en el extremo receptor, la conversión inversa.

La principal ventaja de este tipo de cable es un nivel extremadamente alto de inmunidad al ruido y ausencia de radiación. La conexión no autorizada es muy difícil. Tasa de transferencia de datos 3Gbps. Las principales desventajas de un cable de fibra óptica son la complejidad de su instalación, baja resistencia mecánica y sensibilidad a las radiaciones ionizantes.

Canales de transmisión de datos inalámbricos (canales de radio terrestres y satelitales)

Los canales de radio de comunicaciones terrestres (radio repetidores y celulares) y satelitales se forman utilizando un transmisor y un receptor de ondas de radio y pertenecen a la tecnología de transmisión inalámbrica de datos.

Canales de transmisión de datos de retransmisión de radio

Los canales de comunicación de retransmisión de radio consisten en una secuencia de estaciones que son repetidoras. La comunicación se lleva a cabo dentro de la línea de visión, el alcance entre estaciones vecinas es de hasta 50 km. Las líneas de retransmisión de radio digital (CRRS) se utilizan como sistemas de transmisión de datos y comunicaciones regionales y locales, así como para la comunicación entre estaciones base celulares.

Canales de datos satelitales

Los sistemas satelitales utilizan antenas de microondas para recibir señales de radio de las estaciones terrestres y retransmitir esas señales a las estaciones terrestres. Las redes satelitales utilizan tres tipos principales de satélites, que se encuentran en órbitas geoestacionarias, órbitas medias o bajas. Los satélites se lanzan, por regla general, en grupos. Separados unos de otros, pueden cubrir casi toda la superficie de la Tierra. El funcionamiento del canal de transmisión de datos por satélite se muestra en la figura.

Arroz. 1.

Es más conveniente utilizar las comunicaciones por satélite para organizar un canal de comunicación entre estaciones ubicadas a distancias muy grandes y la posibilidad de atender a los suscriptores en los puntos más inaccesibles. El rendimiento es alto: varias decenas de Mbps.

Enlaces de datos celulares

Los canales de radio celular se basan en los mismos principios que las redes de telefonía celular. La comunicación celular es un sistema de telecomunicaciones inalámbricas que consta de una red de estaciones transceptoras de base terrestre y un conmutador celular (o centro de conmutación móvil).

Las estaciones base están conectadas al centro de conmutación, que proporciona comunicación tanto entre las estaciones base como con otras redes telefónicas y con Internet global. En términos de funciones, el centro de conmutación es similar a un PBX convencional con cable.

LMDS (Sistema de distribución multipunto local) es un estándar para redes de transmisión de datos inalámbricos celulares para suscriptores fijos. El sistema se basa en el principio celular, una estación base le permite cubrir un área con un radio de varios kilómetros (hasta 10 km) y conectar varios miles de suscriptores. Las propias BS se combinan entre sí mediante canales de comunicación terrestre de alta velocidad o canales de radio. Velocidad de transferencia de datos de hasta 45 Mbps.

Canales de radio de datos WiMAX(Worldwide Interoperability for Microwave Access) son similares a Wi-Fi. WiMAX, a diferencia de las tecnologías tradicionales de acceso por radio, también funciona con la señal reflejada, fuera de la línea de visión de la estación base. Los expertos creen que las redes WiMAX móviles ofrecen perspectivas mucho más interesantes para los usuarios que las redes WiMAX fijas destinadas a clientes corporativos. La información se puede transmitir a distancias de hasta 50 km a velocidades de hasta 70 Mbps.

Canales de radio de datos MMDS(Sistema de Distribución Multipunto Multicanal). Estos sistemas son capaces de dar servicio a un área dentro de un radio de 50-60 km, mientras que la visibilidad directa del transmisor del operador no es obligatoria. La velocidad de datos media garantizada es de 500 Kbps - 1 Mbps, pero es posible proporcionar hasta 56 Mbps por canal.

Canales de transmisión de datos de radio para redes locales. El estándar de comunicación inalámbrica para las redes de área local es la tecnología Wi-Fi. Wi-Fi proporciona conexión en dos modos: punto a punto (para conectar dos PC) y conexión de infraestructura (para conectar varias PC a un punto de acceso). Tasa de intercambio de datos de hasta 11 Mbps con conexión punto a punto y hasta 54 Mbps con conexión de infraestructura.

Canales de radio de datos bluetooht es una tecnología para la transmisión de datos en distancias cortas (no más de 10 m) y se puede utilizar para crear redes domésticas. La velocidad de transferencia de datos no supera 1 Mbps.

La difusión de la información se produce en el proceso de su transmisión.

En transferencia de información Siempre hay dos objetos: la fuente y el receptor de la información. Estos roles pueden cambiar, por ejemplo, durante un diálogo, cada uno de los participantes actúa como fuente o como receptor de información.

La información pasa de la fuente al receptor a través de un canal de comunicación en el que debe estar asociada a algún transportador de materiales. Para transmitir información, las propiedades de este portador deben cambiar con el tiempo. Entonces, una bombilla que está encendida todo el tiempo transmite información solo de que se está llevando a cabo algún proceso. Si enciende y apaga la bombilla, puede transmitir una variedad de información, por ejemplo, utilizando el código Morse.

Cuando la gente habla, el portador de información son las ondas de sonido en el aire. En las computadoras, la información se transmite mediante señales eléctricas u ondas de radio (en dispositivos inalámbricos). La información se puede transmitir utilizando luz, un rayo láser, un sistema de comunicación telefónica o postal, una red informática, etc.

La información llega a través del canal de comunicación en forma de señales que el receptor puede detectar usando sus sentidos (o sensores) y “entender” (decodificar).

Señal- Este es un cambio en las propiedades de los medios, que se utilizan para transferir información.

Ejemplos de señales son un cambio en la frecuencia y el volumen del sonido, un destello de luz, un cambio en el voltaje en los contactos, etc.

Una persona puede recibir señales solo con la ayuda de sus sentidos. Para transmitir información, por ejemplo, utilizando ondas de radio, se necesitan dispositivos auxiliares: un transmisor de radio que convierte el sonido en ondas de radio y un receptor de radio que realiza la conversión inversa. Te permiten ampliar las capacidades de una persona.

Es imposible transmitir mucha información con una sola señal. Por lo tanto, la mayoría de las veces, no se usa una sola señal, sino una secuencia de señales, es decir, mensaje. Es importante entender que un mensaje es solo un "caparazón" para la transmisión de información, y la información es contenido mensajes El propio receptor debe "extraer" información de la secuencia de señales recibida. Es posible recibir un mensaje pero no recibir la información, por ejemplo, escuchando un discurso en un idioma desconocido o interceptando un cifrado.

La misma información se puede transmitir usando diferentes mensajes, por ejemplo, a través de un discurso oral, usando una nota o usando un semáforo de bandera, que se usa en la flota. Al mismo tiempo, el mismo mensaje puede llevar información diferente para diferentes receptores. Así que la frase “Está lloviendo en Santiago”, transmitida en 1973 en las frecuencias de las radios militares, para los simpatizantes del General A. Pinochet sirvió como señal para iniciar un golpe de Estado en Chile.

Así, la información se presenta y transmite en forma de una secuencia de señales, símbolos. Desde la fuente hasta el receptor, el mensaje se transmite a través de algún medio material. Si se utilizan medios técnicos de comunicación en el proceso de transmisión, se denominan canales de transmisión de información (canales de información). Estos incluyen teléfono, radio, TV. Los órganos de los sentidos humanos juegan el papel de canales de información biológica.

El proceso de transmisión de información a través de canales de comunicación técnica procede de acuerdo con el siguiente esquema (según Shannon):

La información se puede transmitir utilizando cualquier lenguaje de codificación de información que sea comprensible tanto para la fuente como para el receptor.

codificador- un dispositivo diseñado para convertir el mensaje original de la fuente de información a una forma conveniente para la transmisión.

decodificador- un dispositivo para convertir el mensaje codificado en el original.

Ejemplo. Durante una conversación telefónica: la fuente del mensaje es la persona que habla; un codificador, un micrófono, convierte los sonidos de las palabras (ondas acústicas) en impulsos eléctricos; canal de comunicación - red telefónica (cable); dispositivo decodificador: esa parte del tubo que llevamos a nuestro oído, aquí las señales eléctricas se convierten nuevamente en sonidos que escuchamos; el receptor de la información es el oyente.

El término "ruido" se refiere a varios tipos de interferencia que distorsionan la señal transmitida y conducen a la pérdida de información. Tales interferencias, en primer lugar, surgen por razones técnicas: mala calidad de las líneas de comunicación, inseguridad entre sí de varios flujos de información transmitidos por los mismos canales. Se utilizan varios métodos para protegerse contra el ruido, por ejemplo, el uso de varios tipos de filtros que separan la señal útil del ruido. Existe una ciencia que desarrolla formas de proteger la información: la criptología, que se usa ampliamente en la teoría de la comunicación.

Claude Shannon desarrolló una teoría de codificación especial que proporciona métodos para lidiar con el ruido. Una de las ideas importantes de esta teoría es que el código transmitido por la línea de comunicación debe ser redundante. Debido a esto, se puede compensar la pérdida de alguna parte de la información durante la transmisión. Sin embargo, no puede hacer que la redundancia sea demasiado grande. Esto conducirá a retrasos y mayores costos de comunicación. En otras palabras, para que el contenido de un mensaje distorsionado por una interferencia sea recuperable, debe ser redundante es decir, debe contener elementos "extra", sin los cuales el significado todavía se restaura. Por ejemplo, en el mensaje "Vlg vpdt to Kspsk mr", muchos adivinarán la frase "Volga fluye hacia el Mar Caspio", de la que se eliminaron todas las vocales. Este ejemplo sugiere que los lenguajes naturales contienen muchos "superfluos", su redundancia se estima en un 60-80%.

Al discutir el tema de medir la velocidad de transferencia de información, se puede usar una analogía. Un análogo es el proceso de bombear agua a través de tuberías de agua. Aquí, las tuberías son el canal para la transmisión de agua. La intensidad (velocidad) de este proceso se caracteriza por el consumo de agua, es decir, el número de litros bombeados por unidad de tiempo. En el proceso de transmisión de información, los canales son líneas de comunicación técnica. Por analogía con una tubería de agua, podemos hablar del flujo de información que se transmite a través de los canales. La tasa de transferencia de información es el volumen de información de un mensaje transmitido por unidad de tiempo. Por tanto, las unidades para medir la velocidad del flujo de información: bit/s, bytes/s, etc.

Otro concepto, el ancho de banda de los canales de información, también se puede explicar utilizando la analogía de la "plomería". Puede aumentar el flujo de agua a través de las tuberías aumentando la presión. Pero este camino no es interminable. Si se aplica demasiada presión, la tubería puede explotar. Por lo tanto, el caudal máximo de agua, que se puede llamar la capacidad del suministro de agua. Las líneas de comunicación de datos técnicos también tienen un límite de velocidad de datos similar. Las razones de esto también son físicas.

Considere canales que difieren en el tipo de líneas de comunicación utilizadas en ellos.

1. Mecánico, en el que se utiliza el movimiento de cualquier cuerpo sólido, líquido o gaseoso para transmitir información. En el primer caso se pueden utilizar palancas o cables (por ejemplo, controles de automóviles), en el segundo, sistemas hidráulicos (por ejemplo, el sistema de frenado de un automóvil), en el tercero, diversos tipos de dispositivos neumáticos (muy utilizados, por ejemplo, en la industria del gas).

2. Acústico. Utilizan vibraciones mecánicas de sonido y frecuencias ultrasónicas, que se propagan especialmente bien en medios líquidos. Son muy utilizados, por ejemplo, para transmitir información a personas o dispositivos bajo el agua o en otro medio líquido, así como en investigación médica (ultrasonidos). Un canal acústico en un medio gaseoso es casi el principal para transmitir información entre personas (habla). Las señales acústicas de baja intensidad son inofensivas para la salud humana.

4. Canales eléctricos. Lo más habitual en la actualidad a la hora de transmitir información en distancias cortas. La base son las líneas de comunicación por cable.

5. Canales de radio. Al igual que las ópticas, utilizan ondas electromagnéticas para transmitir información. Sin embargo, a una frecuencia mucho más baja. Debido a la capacidad de tales ondas para doblarse alrededor de los obstáculos y reflejarse en las capas de plasma que rodean la Tierra, es posible transmitir información a largas distancias, incluso a la escala de toda la Tierra. Estas ventajas, sin embargo, son una fuente de desventajas. Los canales de radio son muy susceptibles a las interferencias y menos sigilosos. Se puede utilizar un canal de radio, junto con un canal óptico, para conectarse a la red informática de Internet en áreas con una infraestructura de telecomunicaciones por cable subdesarrollada.

Fin del trabajo -

Este tema pertenece a:

Teoría de la información y la codificación

Universidad Estatal de Sochi.. Turismo y negocios turísticos.. Facultad de Tecnología de la Información y Matemáticas..

Si necesitas material adicional sobre este tema, o no encontraste lo que buscabas, te recomendamos utilizar la búsqueda en nuestra base de datos de obras:

Qué haremos con el material recibido:

Si este material le resultó útil, puede guardarlo en su página en las redes sociales:

| Pío |

Todos los temas de esta sección:

curso de lectura

La organización eficaz del intercambio de información es cada vez más importante como condición para el éxito de las actividades prácticas de las personas. La cantidad de información necesaria para el funcionamiento normal de los modernos

Definición del concepto de información

La palabra información proviene del latín informare - representar, componer un concepto sobre algo, informar. La información junto con la materia y la energía es primaria.

Fases de la circulación de la información

El sistema de control consiste en un objeto de control, un complejo de medios técnicos que consiste en una computadora, dispositivos de almacenamiento de información y entrada-salida incluidos en él, dispositivos de recolección de transmisión

Algunas definiciones

Los datos o señales organizados en ciertas secuencias transportan información no porque repitan objetos del mundo real, sino por convención social sobre la codificación, es decir, uno

Medidas de Información

Antes de pasar a las medidas de información, señalamos que las fuentes de información y los mensajes que generan se dividen en discretas y continuas. Los mensajes discretos se componen de finitamente

medida geométrica

La determinación de la cantidad de información por el método geométrico se reduce a medir la longitud de la línea, el área o el volumen del modelo geométrico de un determinado portador de información o mensaje. Por dimensiones geométricas

Medida aditiva (medida Hartley)

La medida aditiva puede considerarse como una medida combinatoria más conveniente para varias aplicaciones. Nuestras intuiciones acerca de la información sugieren que la cantidad de información aumenta con

La entropía y sus propiedades.

Hay varios tipos de medidas estadísticas de información. En lo que sigue, consideraremos solo uno de ellos, la medida de Shannon. La medida de Shannon de la cantidad de información está estrechamente relacionada con el concepto

Entropía y entropía media de un evento simple

Consideremos con más detalle el concepto de entropía en diferentes versiones, ya que se utiliza en la teoría de la información de Shannon. La entropía es una medida de la incertidumbre de alguna experiencia. En el caso más simple, se

Método del multiplicador de Lagrange Derivación de la fórmula para el valor promedio de entropía por carta de mensaje Entropía de un evento complejo que consta de varios eventos dependientes Redundancia de mensajes Contenido de la información Utilidad de la información Entropía dinámica Entropía de mensajes continuos El primer caso (los valores de las siguientes cantidades están limitados por el intervalo) Segundo caso (se dan la varianza y la expectativa matemática del siguiente valor) cuantización de la señal Tipos de discretización (cuantización) Criterios para la precisión de la representación de una señal cuantificada Elementos de la teoría espectral generalizada de señales Sobre el uso práctico del teorema de Kotelnikov Selección del período de muestreo (cuantificación del tiempo) según el criterio de la mayor desviación Interpolación usando polinomios de Lagrange Estimación del valor máximo del error en la obtención de la función reproductora a partir del polinomio de Lagrange Generalización al caso de utilizar polinomios de Lagrange de orden arbitrario Selección del intervalo de muestreo por el criterio de desviación estándar Cuantificación de nivel óptimo Cálculo del óptimo no uniforme en el sentido del error mínimo de varianza de la escala de cuantificación Conceptos generales y definiciones. Codificación de objetivos Elementos de la teoría de la codificación desigualdad de kraft Teorema 2. Teorema 3. Teorema sobre la longitud media mínima de una palabra de código para la codificación de bloques (Teorema 4) Códigos no uniformes óptimos Lema 1. Sobre la existencia de un código óptimo con la misma longitud de palabras de código de dos letras codificadas menos probables Lema 2. Sobre la optimalidad del código de prefijo de un conjunto no reducido si el código de prefijo del conjunto reducido es óptimo

Características de los códigos eficientes Codificación de corrección de ruido Los modelos más simples de canales de comunicación digital con interferencia. Cálculo de la probabilidad de distorsión de una palabra clave en DSMK Principios generales para el uso de la redundancia Límite de Hamming Redundancia de códigos de corrección de errores códigos de línea Determinación del número de dígitos adicionales m Construcción de una matriz generadora Orden de codificación Orden de decodificación Códigos cíclicos binarios Algunas propiedades de los códigos cíclicos Construyendo un código con una capacidad correctiva dada Descripción matricial de códigos cíclicos Elegir un polinomio generador Ancho de banda de los canales de comunicación Ancho de banda de un canal de comunicación discreto con ruido Secuencias típicas y sus propiedades. Teorema principal de Shannon para un canal discreto con ruido Discusión del teorema principal de Shannon para un canal ruidoso Rendimiento de un canal continuo en presencia de ruido aditivo Paso 2. Ingresar archivos de texto en una hoja de cálculo de Excel, dividiendo cada línea de texto en caracteres separados Paso 4. Encuentra la entropía promedio por 1 letra del mensaje Paso 8. Escribamos un informe de progreso que describa todos los cálculos y cómo se realizaron. Comenta los resultados Conexión de la posibilidad de utilizar funciones no estándar Creación de una función personalizada Grabación de voz y preparación de señal. Importar datos de texto en Excel La cuantificación de nivel se reduce a reemplazar el valor de la señal original con el nivel del paso dentro del cual cae este valor códigos Huffman El proceso se repite hasta que solo quede una letra en cada subgrupo. Parámetros de eficiencia de los códigos óptimos Características de los códigos eficientes Finalización de la obra Construcción de una matriz generadora Orden de codificación Orden de decodificación Finalización de la obra

Si necesita encontrar un extremo (máximo, mínimo o punto de silla) de una función de n variables f(x1, x2, …, xn) asociadas con k

Supongamos que hay un mensaje que consta de n letras: , donde j=1, 2, …, n ─ números de letras en el mensaje en orden, e i1, i2, … ,en números

Ahora suponga que los elementos del mensaje (letras) son interdependientes. En este caso, la probabilidad de ocurrencia de una secuencia de varias letras no es igual al producto de las probabilidades de ocurrencia

Como se señaló, la entropía es máxima si las probabilidades de los mensajes o símbolos a partir de los cuales se componen son las mismas. Dichos mensajes llevan la máxima información posible. Si el mensaje tiene

La medida del contenido se indica con cont (del inglés Content ─ content). El contenido del evento I se expresa a través de la función de la medida del contenido de su sobre

Si la información se utiliza en los sistemas de gestión, entonces es razonable evaluar su utilidad por el efecto que tiene sobre el resultado de la gestión. En este sentido, en 1960, el científico soviético A.A.

Aquí la entropía se considera como una función del tiempo. En este caso, el objetivo es deshacerse de la incertidumbre, es decir. lograr una posición donde la entropía sea igual a 0. Esta situación es típica para problemas

Los datos sin procesar a menudo se presentan como valores continuos, como la temperatura del aire o del agua de mar. Por tanto, es de interés medir la cantidad de información contenida en dichos mensajes.

La variable aleatoria a está limitada por el intervalo . En este caso, la integral definida de su densidad de distribución de probabilidad (ley de distribución de probabilidad diferencial) en

Supongamos ahora que el dominio de definición de los valores de una variable aleatoria no está limitado, pero se dan su varianza D y su esperanza matemática M. Nótese que la varianza es directamente proporcional a

Las señales continuas - portadores de información - son funciones continuas de un argumento continuo - el tiempo. La transmisión de dichas señales puede realizarse utilizando canales de comunicación continuos,

Los tipos de cuantización más simples y más utilizados son: · cuantización por nivel (diremos simplemente cuantización); cuantización del tiempo (llamaremos

Como resultado de la conversión inversa de una forma continua-discreta a una continua, se obtiene una señal que difiere de la original en la cantidad de error. La señal se llama la función de reproducción.

La teoría espectral generalizada de señales combina los métodos de descripción matemática de señales y ruido. Estos métodos permiten proporcionar la redundancia de señales requerida para reducir el efecto de la interferencia.

Un posible esquema para la cuantificación-transmisión-recuperación de una señal continua se puede representar como se muestra en la Fig. 2.5. Arroz. 2.5. Posible esquema de transferencia de cuantificación

Como resultado de la cuantificación en el tiempo de la función x(t), se obtiene una serie de valores x(t1), x(t2),… de la cantidad cuantificada x(t) en tiempos discretos t

La función de reproducción en la mayoría de los casos se calcula mediante la fórmula: , donde son algunas funciones. Estas características por lo general tienden a elegir de manera que. (2.14) En este caso,

Encuentre el error de interpolación. Representémoslo como: , (2.16) donde K(t) es una función auxiliar a hallar. Para t* arbitrario tenemos: (

La interpolación por polinomios de orden n se considera de forma similar a los casos anteriores. En este caso, se observa una complicación importante de las fórmulas. La generalización conduce a una fórmula de la siguiente forma:

Considere el caso de la discretización de un proceso ergódico estacionario aleatorio x(t) con una función de correlación conocida. Restauraremos usando polinomios de Lagrange. Más amenudo

La figura 2.13 ilustra el principio de cuantificación de nivel. Arroz. 2.13. Cuantificación de nivel. Esta cuantificación se reduce a reemplazar el valor de la señal de nivel original

Arroz. 2.19. Notación Ahora fijemos el número de pasos de cuantificación n, los límites del intervalo (xmin, xmax

La codificación es la operación de identificar caracteres o grupos de caracteres de un código con caracteres o grupos de caracteres de otro código. Código (código francés), un conjunto de conocimientos

Algunas propiedades generales de los códigos. Veamos ejemplos. Supongamos que una fuente discreta sin memoria, es decir dando mensajes independientes - cartas - a la salida, teniendo

Teorema 1. Si los números enteros n1, n2, …, nk satisfacen la desigualdad (3.1) existe un código prefijo con un alfabeto de tamaño m,

Formulación. Sea un código con longitudes de palabras de código n1, n2, …, nk y con un alfabeto de volumen m. Si el código es decodificable de forma única, entonces la desigualdad de Kraft satisface

Formulación. Dada la entropía H de la fuente y el volumen m del alfabeto secundario, existe un código de prefijo con la longitud media mínima nav min

Consideremos ahora el caso de codificar no letras fuente individuales, sino secuencias de letras L. Teorema 4. Enunciado. Para una fuente discreta dada

Definiciones. Los códigos desiguales son códigos cuyas palabras de código tienen diferentes longitudes. La optimalidad puede entenderse de diferentes maneras, dependiendo de

Formulación. Para cualquier fuente con k>=2 letras, hay un código binario óptimo (en el sentido de la longitud promedio mínima de una palabra de código) en el que las dos capas menos probables

Formulación. Si algún código de prefijo del conjunto reducido U" es óptimo, entonces el código de prefijo correspondiente del conjunto original m

1. A la letra del alfabeto primario con menor probabilidad de ocurrencia se le asigna el código de mayor longitud (Lema 1), es decir dicho código no es uniforme (con diferentes longitudes de palabras de código). en r

Como su nombre lo indica, dicha codificación está diseñada para eliminar los efectos nocivos de la interferencia en los canales de transmisión de información. Ya se ha informado que tal transmisión es posible tanto en el espacio como en el espacio.

La propiedad de los códigos de corrección de errores para detectar y corregir errores depende en gran medida de las características de la interferencia y del canal de transmisión de información. La teoría de la información suele considerar dos simples

Suponga que la palabra clave consta de n símbolos binarios. La probabilidad de no distorsión de la palabra clave, como es fácil de demostrar, es igual a: . La probabilidad de distorsión de un carácter (solo

Para simplificar, considere el código de bloque. Con su ayuda, a cada k bits (letras) de la secuencia de entrada se le asigna una palabra de código de n bits. Cantidad de diferente tipo

El límite Q de Hamming determina el número máximo posible de palabras de código permitidas de un código uniforme para una longitud de palabra de código dada n y la capacidad correctiva del código CSC

Una de las características de un código es su redundancia. Un aumento en la redundancia es, en principio, indeseable, ya que aumenta el volumen de datos almacenados y transmitidos, sin embargo, para combatir distorsiones, exceso

Considere una clase de códigos algebraicos llamados lineales. Definición: Los códigos lineales se denominan códigos de bloque, de los cuales se forman dígitos adicionales

Para determinar el número de dígitos adicionales, puede usar la fórmula del límite de Hamming: . En este caso, se puede obtener un código densamente empaquetado, es decir código con mínimo para pares dados

Los códigos lineales tienen la siguiente propiedad: del conjunto total de 2k palabras de código permitidas, que por cierto forman un grupo, es posible seleccionar subconjuntos de k palabras que tienen

El procedimiento anterior para construir un código lineal tiene varias desventajas. Es ambiguo (el MDS se puede especificar de varias maneras) y es inconveniente en la implementación en forma de dispositivos técnicos. Estas deficiencias

Todas las propiedades de los códigos cíclicos están determinadas por un polinomio generador. 1. Un código cíclico cuyo polinomio de formación contiene más de un término detecta todos los errores individuales.

Existe un procedimiento simple para construir un código con una capacidad correctiva determinada. Consiste en lo siguiente: 1. Según un tamaño dado del componente de información de una palabra clave con una longitud

Los códigos cíclicos, como cualquier código lineal, se pueden describir mediante matrices. Recuerde que KC(X) = gm(X)*U(X) . Recordemos también el ejemplo del orden de la multiplicación

Está claro que los polinomios de la palabra clave KS(X) deben ser divisibles por el polinomio generador g(X) sin resto. Los códigos cíclicos pertenecen a la clase de códigos lineales. Esto significa que para estos códigos hay

Este tema es uno de los centrales en la teoría de la información. Considera las capacidades limitantes de los canales de comunicación para la transmisión de información, determina las características de los canales que afectan a estos

Ahora investigamos el rendimiento de un canal de comunicación discreto con ruido. Hay un gran número de modelos matemáticos de tales canales. El más simple de ellos es un canal con independientes

Consideraremos secuencias de letras estadísticamente independientes. Según la ley de los grandes números, lo más probable son las sucesiones de longitud n, en las que, para el número N

Formulación Para un canal discreto en ruido, existe un método de codificación que puede garantizar la transmisión sin errores de toda la información proveniente de la fuente.

El teorema de Shannon para un canal ruidoso no indica un método de codificación específico que asegure una transmisión confiable de información a una velocidad arbitrariamente cercana a la capacidad del canal con

Considere el siguiente modelo de canal: 1. El canal es capaz de transmitir oscilaciones con frecuencias por debajo de Fm. 2. Hay interferencia n(t) en el canal, que tiene un normal (gau

Al ingresar un archivo de texto guardado anteriormente, especifique el tipo de archivo *.*. Esto le permitirá ver todos los archivos en la lista durante la selección. Especifique su archivo. Después de eso, la ventana M aparecerá en la pantalla.

Como se describe en la introducción teórica, la entropía promedio se encuentra usando las fórmulas 1 y 2. En ambos casos, debe encontrar las probabilidades de que ocurran letras o combinaciones de dos letras. Las probabilidades pueden ser

Presente los resultados del cálculo en forma de tabla:<Язык 1>

<Язык

El control programático de las aplicaciones que forman parte de Microsoft Office se realiza mediante las denominadas macros. La palabra macro es de origen griego. Traducción

Antes de crear funciones personalizadas, debe abrir el archivo en un libro de trabajo que contenga la información que desea procesar con estas funciones personalizadas. Si este libro de trabajo fue previamente

La grabación comienza y finaliza presionando el botón Grabar (Fig. 5), marcado con un círculo rojo. Durante el proceso de grabación, el botón Grabar se ve presionado y más claro (resaltado).

Haga doble clic para abrir un archivo de texto con datos exportados del programa Wavosaur (Fig. 23). Arroz. 23. Vista aproximada de los datos Se puede ver que los datos exportados

La cuantificación de nivel es una condición necesaria para convertir una señal continua en forma digital. Sin embargo, la cuantificación de nivel por sí sola no es suficiente para esto: para la conversión a formato digital.

Este algoritmo se utiliza para construir el procedimiento para la construcción de un código óptimo, propuesto en 1952 por el médico del Instituto Tecnológico de Massachusetts (EE. UU.) David Huffman: 5) letras de la primera

Considere un alfabeto de ocho letras. Está claro que en la codificación convencional (no estadística), cada letra requiere tres caracteres para representar. El mayor efecto

Hay 2 de estos parámetros: el coeficiente de compresión estadística y el coeficiente de eficiencia relativa. Ambos parámetros caracterizan el grado de reducción de la longitud media de la palabra clave. Mientras que la duración media

5. A la letra del alfabeto primario con menor probabilidad de ocurrencia se le asigna el código de mayor longitud (Lema 1), es decir dicho código no es uniforme (con diferentes longitudes de palabras de código). en r

El trabajo de laboratorio No. 4 se lleva a cabo bajo el control de un programa de control especialmente escrito. Este programa de control está escrito en Visual Basic 6. El archivo ejecutable del programa lleva y

Los códigos lineales tienen la siguiente propiedad: del conjunto completo de 2k palabras de código permitidas, se pueden seleccionar subconjuntos de k palabras que tengan la propiedad de independencia lineal

La palabra clave CS se obtiene multiplicando la matriz de secuencia de información ||X|| a la matriz generadora ||OM||: ||KC1*n|| = ||X

Como resultado de la transmisión de una palabra de código a través de un canal, la interferencia puede distorsionarla. Esto dará como resultado la palabra clave recibida ||PCS|| puede no coincidir con el ||COP|| original.

El trabajo de laboratorio No. 5, al igual que el trabajo No. 4, se realiza bajo el control de un programa de control escrito en el lenguaje algorítmico Visual Basic 6. El archivo ejecutable del programa se denomina Interferencia.